GEO: как попасть в выдачу ИИ и зачем это нужно бизнесу

Мы изучили несколько свежих материалов по теме GEO — Generative Engine Optimization — и решили собрать из них цельную картину. Потому что тема реально важная, а качественного русскоязычного разбора пока мало. Большинство материалов либо слишком поверхностны («ИИ меняет SEO, адаптируйтесь»), либо уходят сразу в технические детали конкретного инструмента, не объясняя общей логики.

Эта статья — для тех, кто уже понимает, что такое SEO, работает с сайтами или продвигает бизнес. Мы разберём: что такое GEO, почему это не замена SEO, как устроена оптимизация под ИИ-выдачу, какова структура контента, который цитируют нейросети, и можно ли автоматизировать весь процесс. Главный вывод, который прослеживается во всех разобранных нами материалах: GEO — это не будущее, это уже происходит, и кто начнёт сейчас — окажется на год впереди конкурентов.

Что такое GEO и почему это не просто модное слово

GEO расшифровывается как Generative Engine Optimization — оптимизация под генеративные движки. Проще говоря: вы хотите, чтобы ChatGPT, Perplexity, Claude, Gemini или Алиса рекомендовали ваш бизнес, когда пользователь задаёт им вопрос по вашей теме.

Звучит абстрактно? Разберём конкретно.

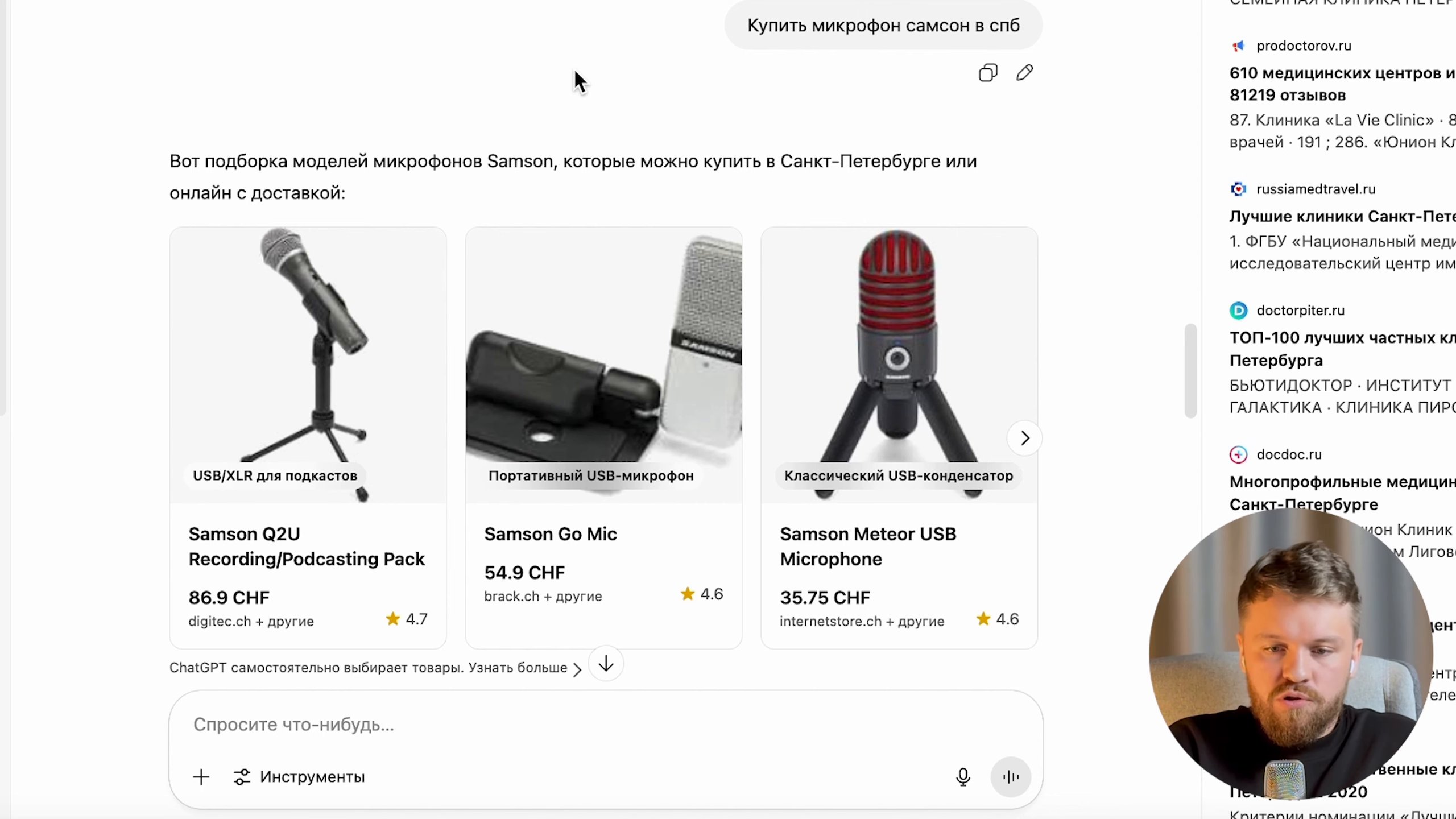

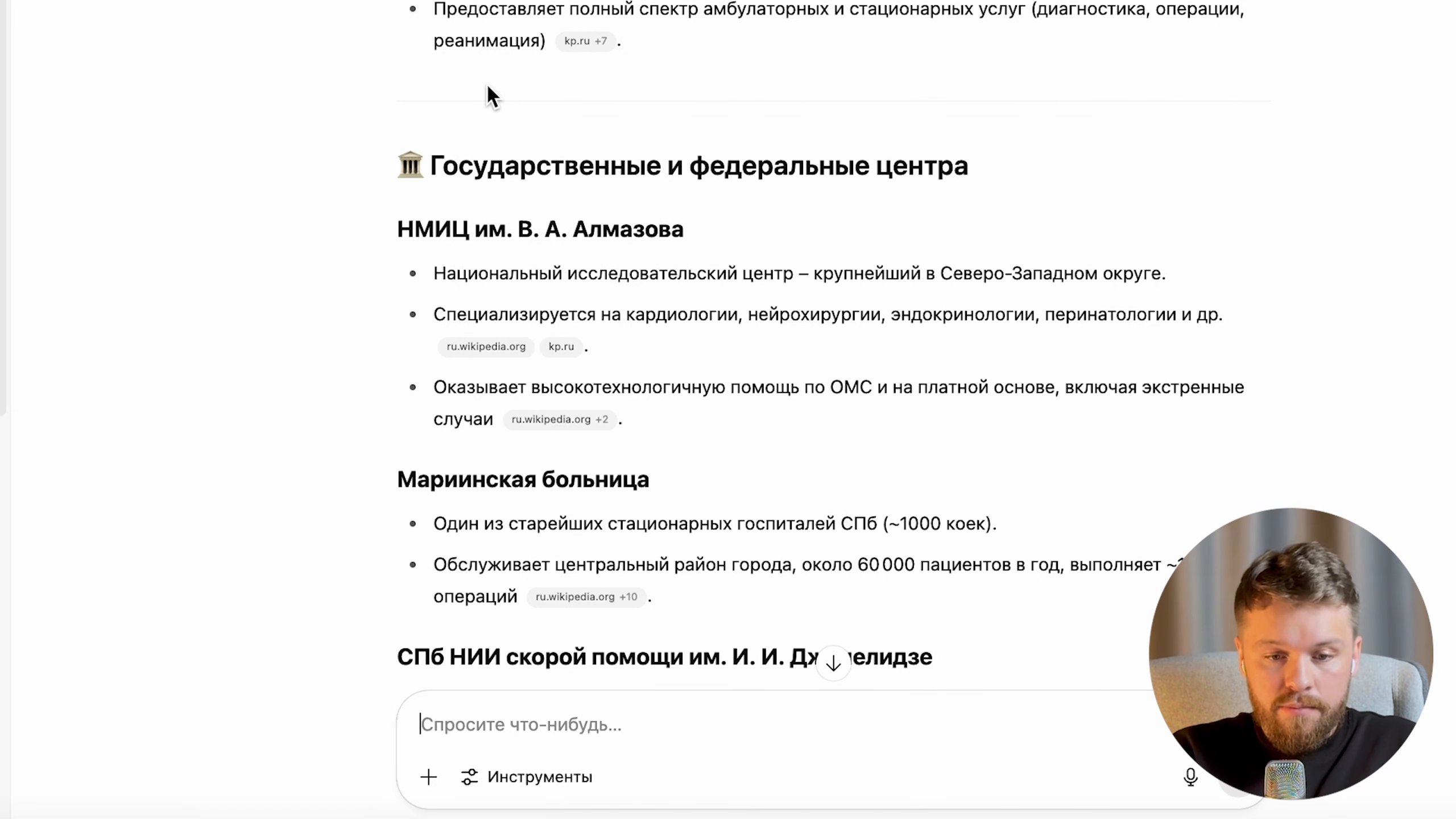

Когда человек вводит в ChatGPT запрос «лучшие клиники Санкт-Петербурга», нейросеть не просто генерирует текст из воздуха — она ссылается на конкретные сайты. В ответе появляются карточки с названиями, кратким описанием и кликабельными ссылками. Точно так же работает AI Overview в Google — блок над основной выдачей, который формирует краткий ответ и указывает источники. В Яндексе этим занимается Алиса.

Вот и суть: пользователь видит не десять синих ссылок, а один сформулированный ответ с двумя-тремя источниками. Остальные девяносто семь сайтов из топа просто не существуют в этот момент для него.

GEO — это борьба за то, чтобы оказаться в тех двух-трёх источниках, а не просто «быть в интернете».

Трафик из классических поисковиков снижается. По разным оценкам, которые встречаются в свежих разборах темы, падение уже составляет порядка 40%. Это не прогноз — это текущее состояние рынка. Причина понятна: зачем переходить на сайт, если ИИ уже дал ответ прямо в интерфейсе?

SEO не умерло. Оно стало фундаментом для GEO

Здесь есть важный момент, который легко упустить. GEO — это не конкурент SEO и не его замена. Это надстройка.

Среди разобранных нами материалов этот тезис звучит особенно жёстко: без качественной базовой SEO-оптимизации попасть в генеративную выдачу невозможно. Нейросети не рекомендуют сайты из ниоткуда. Они обращаются к тем ресурсам, которые уже авторитетны в глазах поисковиков: технически здоровым, с выстроенным ссылочным профилем, с контентом, который хорошо ранжируется по коммерческим запросам.

Разберём по пунктам, что должно быть на месте до того, как вы вообще думаете о GEO:

- Техническая оптимизация — скорость загрузки, корректная мобильная версия, чистая структура URL, мета-теги, schema-разметка

- Внутренняя перелинковка — логичная структура сайта, статьи ссылаются друг на друга

- Внешний ссылочный профиль — и здесь есть распространённое заблуждение

Многие думают, что внешние ссылки нужны только для Google. Это неверно. Цитируемость сайта влияет и на выдачу Алисы в Яндексе, и на то, насколько часто ИИ-инструменты вообще ссылаются на ресурс. Логика простая: нейросети обучаются на данных из интернета. Если на ваш сайт ссылаются авторитетные источники — он попадает в обучающие данные и в индексы, которые модели используют при формировании ответов.

Чем отличается ИИ-трафик от поискового

Это принципиальный момент, который меняет отношение к теме.

Пользователь, который пришёл с органической выдачи Google, кликнул на одну из десяти ссылок — возможно, по инерции, возможно, просто потому что вы в топе. Его интент размытый.

Пользователь, которого ИИ направил на ваш сайт, уже получил контекст. Он спрашивал нейросеть о конкретной проблеме, нейросеть сформулировала ответ и указала ваш ресурс как источник. Он переходит уже «подогретым» — он знает, зачем идёт.

Практика показывает: конверсия с ИИ-трафика выше, чем с классического поискового, примерно на 35%. Поведенческие метрики лучше — пользователь дольше остаётся на странице, меньше отказов. Для Яндекса это особенно важно: поведенческие факторы там влияют на ранжирование значительнее, чем в Google.

Короче: один переход с ChatGPT ценнее трёх переходов с органики. Это уже не теория — агентства, которые работают с продвижением, фиксируют реальные переходы с ChatGPT на сайты клиентов.

Структура статьи, которую цитирует ИИ

А вот тут начинается конкретика. Разберём, каким должен быть контент, чтобы нейросети его цитировали.

Три части статьи: статика, динамика, подвал

Оптимальная структура материала для GEO состоит из трёх чётко разграниченных частей.

Часть 1 — Статичная шапка. Одинакова для всех статей сайта: - Title: 55–60 символов, содержит ключевое слово - Meta description: до 160 символов - Schema-разметка — скрытый технический код, который не виден пользователю, но критически важен для поисковых роботов и ИИ-агентов. Сюда входит разметка хлебных крошек, типа страницы, автора - Хлебные крошки с корректной иерархией

Часть 2 — Динамическое тело. Это ядро статьи. Именно отсюда нейросети берут данные для цитирования. Требования конкретные:

- 8–12 заголовков H2/H3

- Не менее 50% заголовков — в формате вопросов («Как выбрать подрядчика для строительства дома?»)

- Абзацы — по 4 строки, без перегруза

- 1–2 таблицы с ценами или сравнительными данными

- Одна пошаговая инструкция с нумерацией

- Ссылка на авторитетный внешний источник — Википедия, официальная статистика, профильное издание

- 2–3 изображения с подписями и заполненными alt-тегами

- 3–5 внутренних ссылок на другие статьи сайта

- Мягкий и жёсткий офер (призыв к действию)

- Уникальное исследование — блок с реальными данными, собранными из актуальных источников, а не сгенерированными из головы

Часть 3 — Подвал. Замыкает материал: - Краткое резюме статьи - Блок FAQ — вопросы и ответы, сформированные на основе реальных поисковых запросов пользователей (Яндекс.Вордстат, Google Suggest) - Информация об авторе: фото, ссылки на соцсети

Почему нельзя делать все статьи одинаковыми

Есть нюанс, который упускают многие. Если тело каждой статьи на сайте устроено одинаково — блоки в одном и том же порядке от материала к материалу — ИИ «склеивает» их между собой. Это снижает ценность каждой отдельной страницы в глазах нейросети.

Правило: динамическая часть каждой статьи должна иметь уникальный порядок блоков. Таблица может стоять в начале одного материала и в конце другого. Пошаговая инструкция — в середине или после FAQ. Логика должна следовать из контента, а не из шаблона.

Что ИИ точно цитирует: форматы контента

Среди разобранных нами материалов прослеживается устойчивый паттерн. Генеративная выдача предпочитает:

- Форматы «Топ-N»: «10 лучших клиник СПб», «5 способов снизить налоговую нагрузку» — именно такие материалы попадают в ответы ChatGPT и AI Overview

- Пошаговые инструкции с чёткой нумерацией: «Как открыть ПВЗ Ozon: 7 шагов»

- Конкретные цифры: цены, сроки, процентные соотношения, статистика

- Чёткие ответы на вопросы — без вводных конструкций и «воды»

Пример, который хорошо иллюстрирует логику: материал в формате «Топ-10 клиник Санкт-Петербурга 2025», опубликованный на крупном СМИ, попал в генеративную выдачу ChatGPT и стал одним из источников, на которые нейросеть ссылается при ответе на медицинские запросы по городу. Ни уникальность домена, ни накопленный SEO-вес не гарантировали бы такого результата — именно формат материала решил задачу.

Инструменты: где искать своих клиентов через ИИ

Карта платформ, на которых нужно присутствовать:

| Платформа | Доступность в РФ | Тип выдачи |

|---|---|---|

| Perplexity | Без ограничений | Поиск + генеративный ответ |

| ChatGPT | Через VPN | Генеративные ответы со ссылками |

| AI Overview (Google) | Доступно | Блок над поисковой выдачей |

| Алиса (Яндекс) | Без ограничений | Голосовой + текстовый ИИ |

| Claude, Gemini | Частично | Генеративные ответы |

| GPT-модели без VPN | Без ограничений | Аналоги ChatGPT |

Отдельно про Perplexity — это уже не просто чат-бот, а полноценная поисковая система с генеративным ответом. Пользователь вводит запрос, получает структурированный ответ с источниками. Принципиальный момент: компании, которые рекомендует Perplexity, не совпадают с теми, что в топе Яндекса или Google. Проверка на практике: запрос «построить дом в Москве» в обычном поиске выдаёт агрегаторы и крупные платформы — Domclick, Яндекс Недвижимость. В Perplexity — другой набор компаний. SEO-позиции не переносятся автоматически в ИИ-рекомендации.

Автоматизация: можно ли масштабировать GEO без ручного труда

Один из самых интересных углов темы — полная автоматизация производства GEO-контента. Мы видели рабочие системы, построенные на N8N (self-hosted платформа для автоматизации), и они работают.

Вот как выглядит автоматизированный пайплайн:

- Ввод данных: в Google-таблицу заносятся ключевые слова, рубрики сайта, оферы, промты для стиля текста и изображений, город и страна продвижения

- Workflow №1 — Сбор ключей: система берёт ключевое слово и автоматически генерирует LSI-ключи и длинные хвосты под конкретную геолокацию. Из «запустить ПВЗ Ozon» формируется список: «как запустить ПВЗ Ozon в Москве», «стоимость открытия ПВЗ Ozon 2025» и так далее

- Агент-архитектор: генерирует уникальную структуру динамического тела статьи — порядок блоков каждый раз разный. Есть валидатор: если структура не соответствует ТЗ — возвращается на переработку; если ошибка повторяется — уходит уведомление

- Агент-исследователь: собирает реальные данные из открытых источников. Это критично: без него ИИ начинает выдумывать факты — галлюцинировать. Исследователь ищет реальные новости, статистику, контекст

- Агент-журналист: пишет текст по готовой структуре с реальными данными

- Агент-арт-директор: генерирует изображения, автоматически подставляет alt-теги

- Агент продаж: вставляет мягкий и жёсткий оферы

- Сборка и перелинковка: система анализирует уже опубликованные статьи сайта и добавляет внутренние ссылки

- Публикация в WordPress и отправка на индексацию

Весь процесс запускается по расписанию. Человек нужен только для заполнения таблицы с ключами. Результат — производительность страницы 95/100 по PageSpeed, корректная мобильная версия, правильная индексация.

Важный момент: разработка такой системы с нуля — задача нетривиальная. Оценки подрядчиков начинаются от 300 тысяч рублей, и часть специалистов вообще отказывается браться, не понимая архитектуры. Готовые решения на рынке уже появляются.

Практический чек-лист: что делать прямо сейчас

Разберём по пунктам — от базового к продвинутому.

Шаг 1. Проверьте SEO-фундамент - Сайт присутствует в топе по коммерческим запросам? - Есть внешние ссылки с авторитетных доменов? - Скорость загрузки — выше 85/100 по PageSpeed? - Schema-разметка прописана?

Если хотя бы один пункт — нет, начинать с GEO нет смысла. Сначала фундамент.

Шаг 2. Проверьте своё присутствие в ИИ-выдаче - Зайдите в Perplexity (без VPN) и введите ключевые запросы по вашей нише - В ChatGPT (через VPN) или в доступных GPT-аналогах — то же самое - Фиксируйте: кто там уже есть, каких компаний нет, какие форматы контента ИИ цитирует

Шаг 3. Проведите ревизию контента - Есть ли на сайте материалы в формате «Топ-N»? - Есть ли пошаговые инструкции с нумерацией? - В текстах есть конкретные цифры, цены, даты? - Заголовки сформулированы как вопросы хотя бы в 50% случаев?

Шаг 4. Перепишите или создайте приоритетные материалы - Определите 5–10 ключевых запросов, по которым хотите появляться в ИИ-выдаче - Для каждого — создайте материал по структуре: статичная шапка + динамическое тело с таблицей, инструкцией, внешней ссылкой + подвал с FAQ - Наполните реальными данными, не водой

Шаг 5. Настройте мониторинг - Раз в неделю проверяйте вручную: появился ли сайт в ответах нейросетей по вашим запросам - Отслеживайте в аналитике трафик с нетипичных источников — переходы с ChatGPT и Perplexity уже сейчас видны в Google Analytics и Яндекс.Метрике

Шаг 6. Масштабирование - Если объём контента большой — изучите возможность автоматизации на N8N - Минимальный стек: WordPress + N8N на собственном хостинге + таблица с ключами + промты для агентов

Что мы заметили: где материалы сходятся и где расходятся

Изучив несколько часов контента по теме, мы зафиксировали несколько интересных расхождений в подходах.

Где полное согласие: - GEO — это реальный тренд, а не хайп. Переходы с ChatGPT и Perplexity уже фиксируются - SEO — не враг GEO, а его обязательная база - Контент без конкретики не цитируется нейросетями — «вода» не работает - Форматы топов, инструкций и FAQ — наиболее эффективны для попадания в генеративную выдачу

Где подходы расходятся:

Подход А — более технический и автоматизированный: акцент на полной автоматизации производства контента через мультиагентные системы. Логика: GEO требует масштаба, масштаб без автоматизации невозможен, поэтому правильная архитектура системы важнее ручной доводки каждой статьи. Особое внимание — агенту-исследователю, который предотвращает галлюцинации ИИ при создании контента.

Подход Б — более консервативный и фундаментальный: ставит во главу угла SEO-базу и качество существующего контента. Позиция: прежде чем думать об автоматизации, нужно убедиться, что сайт уже является авторитетным источником для поисковиков. GEO без этого не взлетит. Ручная ревизия и переработка существующих материалов — приоритет перед созданием новых.

На наш взгляд, противоречие здесь кажущееся. Оба подхода описывают разные этапы одного пути: сначала фундамент (подход Б), затем масштабирование (подход А). Если начинаете с нуля — сначала SEO-база и ручная оптимизация приоритетных страниц. Если база есть — автоматизация позволяет создавать десятки оптимизированных статей в месяц без роста команды.

Ещё одно расхождение касается роли внешних ссылок в контексте ИИ-выдачи. Более технический подход делает акцент на структуре и уникальности контента внутри сайта. Фундаментальный подход дополнительно подчёркивает: ссылочный профиль влияет не только на Google, но и на то, насколько часто Алиса и другие ИИ-системы вообще обращаются к ресурсу. Мы склонны согласиться с тем, что оба фактора работают в связке.

Итог: рынок уже перестраивается — вопрос только в том, когда вы начнёте

GEO — не про то, чтобы «быть готовым к будущему». Это про то, что прямо сейчас конкуренты с аналогичным сайтом и аналогичным продуктом могут получать трафик из ChatGPT, пока вас там нет. Разрыв будет нарастать: чем раньше сайт начинает появляться в ответах нейросетей, тем больше данных о нём накапливается в обучающих выборках следующих версий моделей.

Хорошая новость: входной барьер пока низкий. Большинство конкурентов ещё не адаптировали контент под генеративную выдачу. Пять переработанных статей в формате «Топ-N» с реальными цифрами, FAQ и внешними ссылками — это уже конкретный шаг. Проверьте прямо сейчас: введите ваш ключевой запрос в Perplexity и посмотрите, кто там есть. Если не вы — это задача на ближайший месяц.